Raspberry Pi NAS – Du stockage réseau DIY performant et économique !

samedi 16 mars 2024 à 09:00

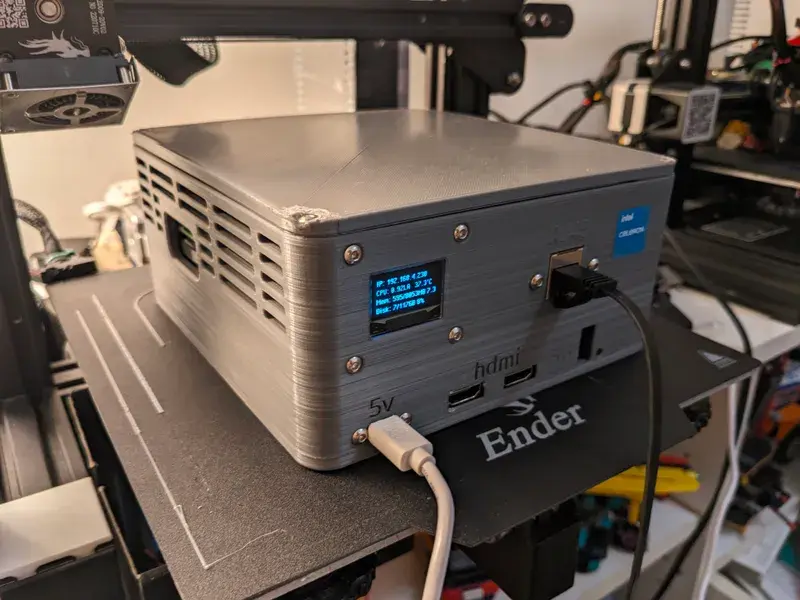

Je ne sais pas si ça va vous motiver pour aujourd’hui ou si on contraire, ça va vous faire poser des congés, mais j’ai découvert grâce à Lorenper, un projet plutôt dingue qui allie la magie du Raspberry Pi et le côté pratique d’un NAS (Network Attached Storage). En gros, imaginez pouvoir créer votre propre espace de stockage en réseau à la maison, à moindre coût et avec une petite bête électronique qui consomme très peu d’énergie.

Hé bien c’est possible grâce au Raspberry Pi NAS qui est un projet DIY dont toutes les étapes sont décrites chez Printables.

Le Raspberry Pi, pour ceux qui ne connaissent pas encore, est un mini-ordinateur à bas coût qui permet de réaliser de nombreux projets DIY (Do It Yourself) à la fois ludiques et utiles. Il est devenu très populaire pour la création de serveurs en tous genres, et notamment pour mettre en place un NAS.

Le truc, c’est que les NAS sont généralement assez chers, et leurs performances ne sont pas toujours à la hauteur de leur prix. J’ai un Synology à la maison et j’en suis très content. Mais grâce au Raspberry Pi, il est maintenant possible de créer un NAS sur mesure, avec des fonctionnalités adaptées à nos besoins, et ce, pour une somme modique.

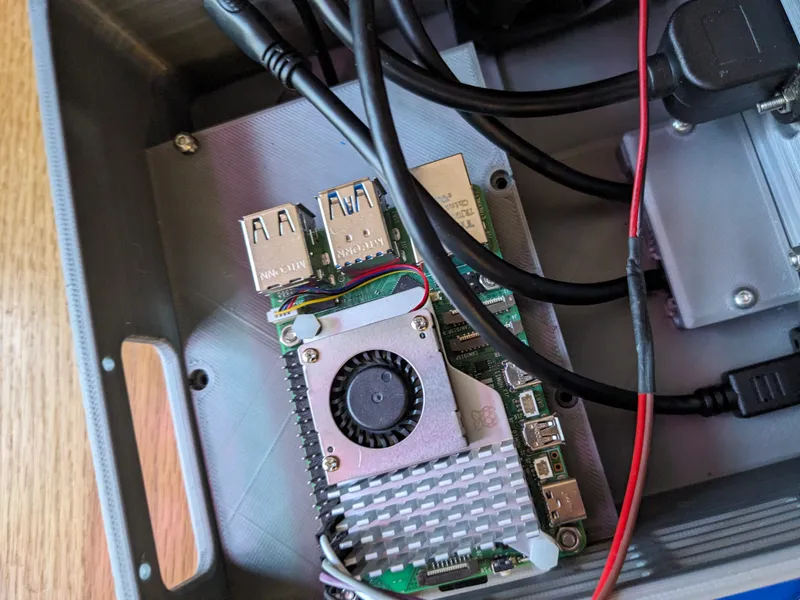

La première étape pour créer un Raspberry Pi NAS consiste à rassembler le matériel nécessaire. Vous aurez besoin d’un Raspberry Pi (de préférence de dernière génération pour bénéficier de performances accrues), d’une carte microSD pour le système d’exploitation, d’un disque dur externe ou d’une clé USB pour le stockage, d’une alimentation adaptée et de deux ou trois autres petites choses telles qu’un écran OLED. Je vous laisse vous référer à la liste du matos sur le site Printables.

Une fois le matériel rassemblé, il faudra préparer la carte microSD avec le système d’exploitation. La distribution la plus populaire pour ce genre de projet est Raspbian. Une alternative intéressante est OpenMediaVault qui intègre déjà de nombreuses fonctionnalités pour un NAS.

Le disque dur externe ou la clé USB que vous choisirez pour le stockage devra être formaté et monté sur le Raspberry Pi. Il est possible d’utiliser différents systèmes de fichiers tels que NTFS, FAT32 ou EXT4. À noter qu’il est également possible de configurer un RAID (Redundant Array of Independent Disks) pour augmenter la capacité de stockage et garantir la sécurité des données. Plus y’a de plus, plus on est à l’aise, blaiz !

En ce qui concerne le partage des fichiers et dossiers sur le réseau, plusieurs protocoles sont disponibles et peuvent être configurés selon vos besoins. Le plus commun est le protocole Samba (non, pas de Janeiro…) qui est compatible avec les systèmes Windows, macOS et Linux. Un autre protocole intéressant est NFS (Network File System) qui fonctionne principalement avec les systèmes Linux et UNIX. Pour ceux qui souhaitent accéder à leurs fichiers depuis le Web, il est possible de mettre en place un serveur FTP (File Transfer Protocol) ou d’utiliser des applications de cloud personnel telles que Nextcloud ou Owncloud.

Mis à part les fonctionnalités de base d’un NAS, le Raspberry Pi permet d’ajouter d’autres services supplémentaires tels que la sauvegarde automatisée de vos données, la synchronisation entre plusieurs dispositifs, l’accès à distance sécurisé via VPN ou encore la diffusion de contenus multimédias en streaming grâce à des logiciels tels que Plex ou Kodi. Vous avez de quoi vous éclater techniquement, ne vous inquiétez pas.

Bref, créer un NAS avec un Raspberry Pi est un projet plutôt cool qui permet d’obtenir un système de stockage en réseau sur mesure, économique et performant. Les possibilités sont presque infinies, et vous pourrez adapter votre NAS à vos besoins spécifiques grâce à la flexibilité offerte par le Raspberry Pi.

Puis si vous voulez faire d’autres trucs avec votre Raspberry Pi, mais que vous n’avez pas d’idées, je vous ai compilé une super liste de projets ici.

Merci à Lorenper