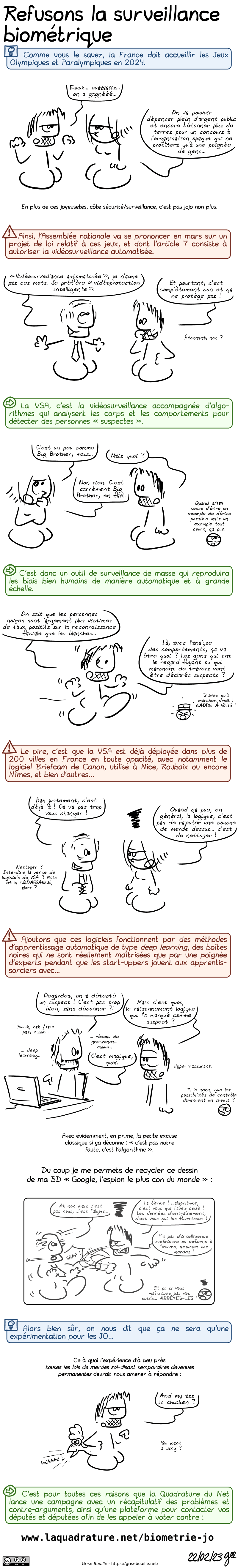

Une BD pour refuser la surveillance biométrique !

vendredi 24 février 2023 à 15:06Nous publions une BD de Grisebouille contre la surveillance biométrique (dont on peut retrouver le site internet ici) de Framasoft. Merci !

source: La Quadrature du Net

Nous publions une BD de Grisebouille contre la surveillance biométrique (dont on peut retrouver le site internet ici) de Framasoft. Merci !

Depuis 2019, l’initiative Technopolice documente et analyse le déploiement illégal des technologies d’intelligence artificielle qui cherchent à augmenter la puissance policière de répression dans l’espace public. En quatre ans, ces technologies se sont perfectionnées et leur promoteurs – des entreprises et des représentants de politiques sécuritaires – tentent de sortir de cette position illégale inconfortable.

Alors que le déploiement de ces IA policières s’est fait dans l’illégalité la plus totale, la loi sur les Jeux Olympiques et Paralympiques de 2024 a précisément pour but d’amorcer cette légalisation de la surveillance biométrique, en commençant par la VSA : la vidéosurveillance algorithmique. Mais pour arriver jusqu’ici, l’industrie a déployé tout un panel de stratégies pour rendre ces technologies acceptables. Décortiquons-les.

Tout d’abord, rappelons la véritable nature des trois technologies phares des entreprises du marché de la surveillance biométrique, qui mêlent captation de nos attributs (couleur des vêtements, sacs, couvre-chefs, etc.), de nos caractéristiques physiques (formes de nos corps, démarche…) et intelligence artificielle.

La vidéosurveillance algorithmique consiste en l’automatisation du travail d’analyse des images de vidéosurveillance grâce à un logiciel, basé sur des algorithmes de « computer vision » (le champ de l’intelligence artificielle spécialisé dans le traitement des images), qui se charge de produire des notifications lorsque qu’il détecte un événement qu’on l’a entraîné à reconnaître, généralement en vue d’une intervention policière. Cette technologie est aussi utilisée pour des usages privés, par exemple pour détecter des intrusions dans une propriété privée ou pour surveiller les clients des supermarchés.

Les algorithmes ayant pour but de reconnaître une information sur une image sont généralement basés sur de l’apprentissage automatique, aussi appelé « machine learning ». Pour pouvoir faire de la reconnaissance sur ces flux vidéo, il convient de traduire des informations (nombre de pixels, position, couleur, et leur évolution dans le temps) en informations statistiques plus intelligibles et manipulables qu’on appelle des caractéristiques.

Nous avons recensé de manière non exhaustive la mise en place de cette technologie dans plus de 200 villes françaises. Par exemple, la VSA peut détecter des « évènements anormaux » qui sont en réalité des comportements anodins tels que des rassemblements ou le fait d’être statiques, mais aussi suivre le parcours d’une personne ou lire des plaques d’immatriculation.

L’audiosurveillance algorithmique fonctionne de la même manière que la VSA mais en utilisant des signaux audio à la place des flux vidéo. Contrairement à la VSA, qui se base sur le parc de vidéosurveillance existant, cette technologie demande d’installer des micros dans les rues. La première ville dans le viseur des collectifs luttant contre la technopolice a été Saint-Étienne, où, sous couvert d’expérimentation la municipalité avait prévu d’installer plusieurs dizaines de capteurs sonores dans un quartier de la ville afin d’en traquer les « bruits suspects » (klaxons, bris de verres, bombes aérosols)… Dès 2019, nous avions pu analyser la gravité du projet qui a finalement été annulé suite à une grande mobilisation des Stéphanoi·ses et un avertissement de la CNIL.

Cela n’a pas empêché la ville d’Orléans de lancer un projet similaire en 2021, contre lequel La Quadrature a déposé un recours, toujours en cours d’examen par le tribunal.

La reconnaissance faciale fonctionne grâce aux mêmes algorithmes de « computer vision » que la VSA, c’est à dire de l’apprentissage statistique qui a pour but d’analyser et déterminer les corrélations et paramètres identiques entre des images. Dans cette application là, les algorithmes sont circonscrits aux traits du visage, on peut donc considérer la reconnaissance faciale comme une sous-catégorie de la VSA.

En France, la reconnaissance faciale est déjà massivement utilisée par la police à travers le fichier de police du Traitement des Antécédents Judiciaires (TAJ). Dans ce cadre, la reconnaissance faciale est utilisée pour créer un lien direct entre le visage d’une personne et son identité civile enregistrée dans le TAJ. Cet usage permet aux agents de comparer, a posteriori, des images de vidéosurveillance ou de réseaux sociaux avec plus de huit millions de photos de personnes contenues dans ce fichier.

De plus, nous avons pu observer plusieurs tentatives d’installation de la reconnaissance faciale dans l’espace public en France. Par exemple, la région PACA a voulu mettre en place des portiques de reconnaissance faciale dans deux lycées, à Nice et à Marseille en 2018. Nous avons fait un recours et le dispositif a été jugé illégal en 2020, car totalement disproportionné, par le Tribunal administratif de Marseille et par la CNIL.

Les entreprises qui proposent des solutions de VSA sont tout autant en mesure de faire de la reconnaissance faciale. Officiellement, la plupart d’entre elles affirment ne pas utiliser les caractéristiques biométriques propres au visage car cela les ferait souffrir d’une trop mauvaise publicité, due au rejet massif de la reconnaissance faciale dans la société. Pourtant, elles utilisent bien d’autres caractéristiques biométriques (analyse des corps et de leurs mouvements) qui leur permettent de vendre leur outils de VSA aux municipalités . De plus, nombre de ces entreprises proposent conjointement la VSA et la reconnaissance faciale dans leurs services, c’est le cas par exemple de Atos, Idemia, Thales, Axis, Avigilon ou encore Two-I.

Nous dénonçons depuis longtemps le lien étroit entre toutes les technologies de surveillance biométrique. Si la VSA venait à être légalisée, les promoteurs de la reconnaissance faciale n’auraient plus qu’à expliquer qu’elle est seulement une application particulière de la VSA pour la faire accepter à son tour, comme un prolongement naturel ou logique. En autoriser une, c’est les accepter toutes, il est donc extrêmement important de ne laisser aucune de ces technologies gagner du terrain.

Le droit actuel fournit une large protection des données personnelles et particulièrement des données biométriques. Nous l’expliquions dans cet article, avec le RGPD et la directive Police-Justice, la surveillance biométrique est pour l’heure strictement illégale. Les promoteurs de la surveillance biométrique sont au fait de cette illégalité. Pour contourner cet obstacle juridique, ils utilisent plusieurs stratégies pour faire exister ces technologies, les rendre acceptables et, in fine, les légaliser.

Comme ces technologies sont déployées en toute opacité, obtenir des informations sur ces stratégies nous a demandé d’employer divers moyens : demandes d’accès à des documents administratifs (pour les appels d’offre et les procès-verbaux de conseils municipaux par exemple), analyse de la communication des entreprises ou réception d’informations par des lanceurs d’alertes (notamment par notre plateforme de leak sécurisée). Récemment, nous avons aussi obtenu auprès de la CNIL les réponses des entreprises à la consultation qu’elle avait lancée il y a un an sur le sujet, que nous citons et publions ici, tant celles-ci sont l’illustration patente de ces techniques d’acceptabilité1Les autres réponses reçues et non citées dans l’article sont disponibles ici : celles de l’association 810, du lobby AFEP, de la ville de Cagnes-sur-mer, du Cerema (Centre d’études et d’expertise sur les risques, l’environnement, la mobilité et l’aménagement), du CNPEN (Comité national pilote d’éthique du numérique), de Décathlon, du Défenseur des droits, de l’entreprise délégué à la protection des données du ministère de l’Intérieur, de la Délégation à la protection des données (DPD) de la Ville et de l’Eurométropole de Strasbourg, du GPMSE (Groupement Professionnel des Métiers de la Sécurité Electronique), d’Île-de-France Mobilités, de la ville du Havre, de la ville de Neuilly -Plaisance, du PERIFEM (groupe réunissant les grandes enseignes de distribution, de l’entreprise Pizzorno, l’entreprise Quantaflow, du thinktank Renaissance Numérique, de l’entreprise Samsara, du groupe Transdev, de la Ville de Nice et de l’entreprise Wintics. <script type="text/javascript"> jQuery('#footnote_plugin_tooltip_20162_2_1').tooltip({ tip: '#footnote_plugin_tooltip_text_20162_2_1', tipClass: 'footnote_tooltip', effect: 'fade', predelay: 0, fadeInSpeed: 200, delay: 400, fadeOutSpeed: 200, position: 'top right', relative: true, offset: [10, 10], });.

L’expérimentation a été une des premières stratégies mises en œuvre pour confronter les publics à la surveillance biométrique et ainsi les habituer à cette technologie. L’appellation d’« expérimentation » permet de donner un sentiment d’éphémère et de réversibilité de leur mise en place.

Dès 2018, nous avons assisté à une tentative d’installation de portiques de reconnaissance faciale à l’entrée de deux lycées à Nice et à Marseille, sous couvert d’expérimentation. De même, la ville de Nice a expérimenté un système de reconnaissance faciale en 2019 lors de son carnaval, expérimentation dont les résultats n’ont jamais été objectivement communiqués.

Pour justifier la violation du RGPD et de la directive Police-Justice, les arguments consistaient à dire que l’expérience de reconnaissance faciale était « limitée dans le temps » et fondée sur le consentement explicite de volontaires. Cette stratégie se résume à faire exister des projets de surveillance biométrique en les « adoucissant » grâce à l’image expérimentale et permet aux promoteurs de la surveillance biométrique d’ancrer ces technologies sur le territoire, de les rendre normales dans nos environnements. Une fois que ces technologies ont une existence physique, il est beaucoup plus facile de les pérenniser et donc de justifier leurs légalisation.

Un grand nombre d’entreprises poussent cette stratégie dans les réponses à la consultation de la CNIL. Par exemple le lobby de la vidéosurveillance AN2V(l’Association Nationale de la « Vidéoprotection ») plaide pour un « droit à l’expérimentation » quand l’entreprise Deveryware juge que « les tests grandeur nature constituent également une nécessité pour vérifier la robustesse du produit, son efficacité et son efficience».

On retrouve exactement le même procédé d’acceptabilité dans le projet de loi sur les Jeux olympiques, celui-ci prévoyant une « expérimentation » dans les évènements récréatifs, sportifs et culturels. Le gouvernement peine à masquer les volontés d’installer la VSA dans le quotidien puisque cette « expérimentation » durerait quasiment deux ans !

Les technologies de surveillance biométriques sont fondées sur des algorithmes de « machine learning » dont l’existence est assez récente et qui sont très en vogue, y compris en dehors de l’industrie de la surveillance. Ils incarnent donc la nouveauté, le progrès et un futur soi-disant « inéluctable ». De nombreuses villes, y compris de très petites communes – comme Moirans en Isère – veulent l’adopter pour se donner une image de progrès et de modernité. Couplé à la stratégie d’expérimentation, il est assez facile pour ses promoteurs de présenter les militants s’opposant à la surveillance biométrique comme des réactionnaires souhaitant « revenir en arrière », alors même que ceux-ci ne font que réclamer la suspension de projets illégaux et présentés initialement comme éphémères.

Pour mettre en avant ces bienfaits, les entreprises s’arment d’un discours publicitaire toujours plus valorisant à l’égard de leurs produits en les présentant comme très efficaces, voire « technomagiques », pour résoudre tout type de problème. Ainsi, dans les réponses à la CNIL, un grand nombre d’acteurs présentent la VSA comme ayant des bénéfices « évidents » pour la sécurité et arguent que les refuser serait préjudiciable pour la société. Pourtant l’évidence de ces bénéfices n’est jamais démontrée.

Pour l’Union des Transports publics et Ferroviaires ( qui voit dans la VSA un « bien commun », le chargé d’affaires publiques était manifestement très inspiré), « le déploiement de nouveaux systèmes de vidéos augmentées est important : il offre une nouvelle capacité d’anticipation et de réaction des opérateurs de service public non seulement en adéquation avec les réalités de fonctionnement du quotidien en matière de transport de masse, mais aussi, en adéquation avec les risques de notre temps et les attentes de « mieux vivre ensemble » du citoyen-voyageur.

Pour l’entreprise Idemia (leader du marché de la reconnaissance faciale), l’intérêt de la vidéosurveillance est « indiscutable » car la VSA « permettrait de réduire le nombre d’agents chargés de l’exploitation des flux des caméras (…) au bénéfice d’agents sur le terrain, plus vite (stratégie des feux naissants) et donc plus directement au service des citoyens». L’entreprise prétend même que les biais algorithmiques – par leur nature supposée quantifiable et maîtrisable – seraient moindres que les biais humains. Cela l’amène à rêver de « salles vidéo aux écrans éteints, et donc une liberté d’aller et de venir retrouvée » car « chaque caméra aura alors l’efficacité d’une patrouille expérimentée, sans avoir les dérives potentielles [des biais humains] ».

Ce discours péremptoire et mensonger de l’industrie – la VSA aurait un « intérêt indiscutable », serait du « bien commun », permettrait de « mieux vivre ensemble » etc. – ne s’accompagne d’aucune étude, d’aucune preuve, il s’agit simplement d’un discours publicitaire qui se retrouve pourtant bien souvent repris sans être questionné par des représentants politiques voulant démontrer qu’ils agissent pour la « sécurité ».

Une autre stratégie utilisée par les promoteurs de la surveillance biométrique est de mettre en concurrence la capacité d’atteinte aux libertés des différents outils de surveillance biométrique pour en présenter certaines comme inoffensives. Tout l’enjeu de cette stratégie est de hiérarchiser ces technologies – pourtant toutes considérées comme illégales par le RGPD et la directive Police-Justice – afin de jeter l’opprobre sur certaines et ainsi maintenir les autres dans l’opacité pour en cacher la gravité. Les entreprises de l’industrie de la surveillance biométrique entendent par cette rhétorique contribuer à dessiner la ligne d’un soi-disant « garde-fou » tout en se donnant l’image de se préoccuper des libertés alors qu’elles sont en réalité en train de les piétiner.

La reconnaissance faciale est alors un outil stratégique très utile. Bien connue et depuis longtemps car très représentée dans la fiction dystopique, elle évoque instantanément la surveillance de masse : elle est dans l’imaginaire collectif la « ligne rouge » à ne pas franchir. Conscientes de cela, les entreprises tentent de créer une différentiation entre la reconnaissance faciale, dangereuse, et les autres technologies de surveillance biométrique – l’ASA et la VSA – qui seraient beaucoup moins graves en comparaison, et donc acceptables.

Le choix des mots utilisés pour nommer et décrire ces technologies représente un enjeu stratégique majeur pour leur acceptabilité par la population. Chaque entreprise développe donc tout un discours marketing mélioratif et dédramatisant visant a éclipser le caractère biométrique de leur surveillance et à le présenter comme moindre par rapports à d’autres technologies plus graves. Dans les réponses envoyées par les entreprises à la CNIL lors de sa consultation sur la VSA, on retrouve beaucoup de ces éléments de langage. Par exemple, l’entreprise francilienne Alyce affirme «qu’il ne peut y avoir de postulat de dangerosité » concernant la VSA, niant ainsi tous les dangers de l’usage des données biométriques pour faire de la surveillance. Elle reconnaît que beaucoup des systèmes de VSA présentent « un fort risque d’intrusion » mais tente de les hiérarchiser en précisant que « tous ne présenteront pas un niveau de risque fort, notamment selon le caractère identifiant des images captées, le niveau d’identification permise par la captation », et cite comme exemple les dispositifs en différé ou bien ceux sur les axes routiers « car notamment insusceptible de révéler des données sensibles ». Rappelons pourtant que la surveillance des axes routiers et notamment la LAPI (le type de VSA qui permet la lecture automatisée des plaques d’immatriculation) fournit un identifiant unique rattachable à l’identité civile du conducteur du véhicule.

De la même manière, l’entreprise Veesion (qui fait de la détection de vol) minimise sa technologie en la comparant à d’autres dans sa présentation : « La technologie de Veesion se fonde uniquement sur un traitement algorithmique de la gestuelle et des attitudes. L’entreprise n’utilise donc ni la reconnaissance faciale, ni le suivi de client, ni l’enregistrement d’identité.»

Ces stratégies se révèlent souvent assez efficaces. Le choix de faire de la reconnaissance faciale un épouvantail attirant toute la lumière, alors que c’est surtout la VSA qui est au cœur du texte de la loi Olympique, a déteint jusqu’au gouvernement, qui a précisé au paragraphe III de l’article 7 que l’expérimentation n’incluait pas la reconnaissance faciale. La présidente CNIL a également foncé dans le piège en soutenant que l’exclusion de la reconnaissance faciale était une garantie.

L’urgence pour l’heure n’est pas de parler de la reconnaissance faciale mais de visibiliser les conséquences de la VSA, au cœur de l’article 7 de la loi : la reconnaissance faciale est massivement rejetée par la population car ses dangers sont connus, c’est beaucoup moins le cas de la VSA qui comporte pourtant des dangers similaires. Il est essentiel de faire connaître cette technologie et de manifester notre opposition. N’hésitez pas à appeler les député·es (on vous explique comment faire ici) pour leur faire prendre conscience de la gravité du texte qu’ils sont en train de voter.

Conscients qu’avec un espace de débat ouvert sur le temps long, les mesures d’augmentation de la surveillance seraient fortement rejetées par la population, les promoteurs de la surveillance biométrique se servent de toutes les occasions possibles leur permettant de précipiter sa légalisation. C’est une stratégie à laquelle nous sommes fréquemment confrontés : l’épidémie de covid-19 a par exemple été prétexte à l’usage de drones, à la mise en œuvre du suivi de nos déplacements et à une accélération de la collecte des données de santé.

L’événement ici instrumentalisé, les Jeux olympiques, a déjà servi par le passé à l’extension de la surveillance. Par exemple, pour les JO de Tokyo, le gouvernement japonais a fait passer une loi « anti-conspiration » voulue de longue date pour mater les groupes militants et syndicaux, et fortement critiquée notamment par les Nations Unies au regard des atteintes aux libertés qu’elle créait et aux pouvoirs de surveillance qu’elle conférait à l’État. Plus récemment, le Qatar a mis en place un grand système de surveillance des personnes assistant à la Coupe du monde de football en 2022.

L’avantage, en terme d’acceptabilité, de se servir d’un événement exceptionnel comme les Jeux olympiques est de venir renforcer le sentiment d’éphémère et d’expérimentation. Dans les réponses à la CNIL, on retrouve l’échéance de la Coupe du monde de Rugby 2023 et des Jeux de Paris 2024 dans quasiment toutes les bouches, comme par exemple celle de Deveryware (page 4), la RATP (page 13) ou encore la SNCF (page 3).

Autre opportunisme que l’on croise très fréquemment dans la technopolice : celui des débouchés économiques. Pour le secteur, le développement des technologies créerait de l’emploi et favoriserait la croissance économique du marché de la surveillance. Aussi, celui-ci doit exister en France pour se positionner face à la concurrence internationale, qui apparaît inéluctable.

Ainsi, l’ancien député Jean-Michel Mis clame la « souveraineté » du marché et pour le réseau Alliance pour la Confiance Numérique (représentant un certain nombre d’entreprises de vidéosurveillance), la CNIL doit « favoriser l’émergence de leaders français de l’intelligence artificielle de confiance et non pas aboutir à des règles ou des situations qui pourraient entraver leurs développements à la faveur d’acteurs non souverains ». Pour Deveryware, « les industriels ont pour mission de créer de la richesse pour la nation avec notamment l’objectif d’exporter leurs solutions » quand Veesion juge qu’un droit d’opposition trop contraignant exposerait « les entreprises du secteur à être considérées comme illégales et donc à arrêter l’ensemble de leurs activités. Cela conduirait à menacer, de manière immédiate, 500 emplois directs en France. »

De nouveau, cette stratégie parvient à ses fins puisqu’elle a été reprise par le ministre de l’Intérieur lui-même pendant les débats sur le projet de loi au Sénat le mois dernier : « Lorsqu’un dispositif est développé avec un cadre français, nous pouvons parler aux industriels, gérer en partie leurs actions, les réguler, regarder leur capital. Soyons fiers des entreprises françaises ! »

Les algorithmes utilisés dans la surveillance biométrique ont des applications bien plus larges que l’analyse des seuls corps humains. Si l’on prend l’exemple de la VSA, les algorithmes de computer vision peuvent très bien être utilisés sur des images ne contenant pas d’activité d’humaine, et n’utilisant donc pas de données biométriques, comme par exemple pour détecter des produits défectueux au bout d’une chaîne de fabrication.

Une stratégie particulièrement mise en avant par les promoteurs de la surveillance biométrique est alors de la rapprocher d’autres usages qui semblent beaucoup moins problématiques. Ils mettent généralement en avant les situations où l’activité humaine est la moins perceptible : repérer des ordures déposées sur des trottoirs ou des bagages abandonnés par exemple. Étant donné que l’objet de la détection n’est pas humain, il est facile de prétendre qu’il s’agit là d’une détection similaire à la détection d’anomalie dans une chaîne de production et de faire fi du fait que, pour aboutir à cette détection, l’algorithme sonde continuellement les flux vidéo de la rue, ou de l’espace public ou se retrouve déposé l’objet. Avec cette technique, les entreprises se gardent bien de faire comprendre que, même pour repérer un objet, les humains sont analysés en permanence.

Ainsi, pour justifier le bon usage de la VSA, l’AN2V mentionne des traitements ne « disposant d’aucun algorithme permettant de détecter des personnes : détection d’animal errant, mesure des traversées d’animaux, ouverture automatique d’une borne sur une rue piétonne sur détection d’un véhicule d’urgence, affichage d’un message ou commande d’un dispositif (feu rouge, borne) sur mesure de vitesse, etc. ». Pour la RATP, « l’amélioration de la puissance d’analyse d’un système de vidéoprotection ne dénature ni ne change la portée de la vidéo [exploitée] depuis de nombreuses années » car dans tous les cas, « que la détection soit d’origine humaine ou algorithmique », l’action des service de police ou de la RATP, serait « identique ».

Autre exemple, quand le maire de Nice laissait croire l’année dernière que le système de VSA qu’il souhaitait mettre en place ne traitait que des données et « générales » et non biométriques (ce qui est faux), afin de minimiser ce que faisait réellement l’algorithme.

Les entreprises ont aussi recours à des jeux rhétoriques et des périphrases. La ville d’Orléans a par exemple

tenté de faire passer l’Audiosurveillance algorithmique implantée dans ses rues par la société Sensivic pour un simple « détecteur de vibration de l’air ». Cette technologie, en réalité basée sur la pose de microphones dans les rues couplés à un logiciel d’analyse algorithmique, fonctionne comme la VSA et la reconnaissance faciale sur de l’analyse de l’activité humaine afin de repérer des cris ou divers bruits. La ville d’Orléans tentait par cette pirouette de faire oublier que cette surveillance était basée sur de l’analyse de données personnelles, et comptait ainsi échapper au RGPD. De la même manière, l’AN2V mentionne des « détection d’anormalité sonore » ou des « signatures sonore », tant de mots techniques destinés à camoufler que l’on parle de la mise sur écoute des personnes.

Une autre rhétorique que l’on a beaucoup rencontré à La Quadrature est, lorsque l’on dénonce l’usage d’une technologie renforçant la surveillance, de s’entendre rétorquer que cet outil aurait un soi-disant caractère neutre et impartial. Les technologies sont alors présentées comme de simples aides techniques, des logiciels sans conséquence.

Concernant la VSA, la stratégie consiste alors à mettre en avant la décision finale de l’humain et à présenter le logiciel comme une simple « aide à la décision » ayant une fonctionnalité de « levée de doute ». Les entreprises insistent alors sur le fait que la véritable décision serait, elle, prise par l’humain au bout de la chaîne, et que la technologie ne serait qu’un outil neutre n’orientant le résultat de la surveillance d’aucune manière.

Par exemple, pour l’ACN, « cette technologie peut aider à la détection de situations pouvant conduire à une infraction, mais ne prend pas, à date, de décision finale automatisée. C’est une simple aide à la décision qui laisse la liberté à l’homme de contrôler/confirmer/infirmer. ». Même chose chez l’Agora (un club de directeurs de la sécurité), « ces signalements sont alors validés ou non par une action humaine. La technologie utilisée dans ce cadre intervient donc en amont, en tant que support de l’action humaine » ou l’AN2V : « Seul le regard et l’interprétation humaine envisage ou non une action ou une procédure. On est là dans un cas d’aide à la décision ».

En réalité, ce travail de « détection de situations » réalisé par le logiciel présuppose d’avoir choisi en amont, d’une part, les événements pertinents à relever et, d’autre part, les critères pertinents pour détecter et retrouver ces évènements sur une image. Ainsi, de nombreuses décisions impactantes et révélant des choix politiques et moraux surviennent au cours du processus de construction de ces algorithmes. En effet, de façon identiques à ce que nous dénoncions pour la CAF, les algorithmes fonctionnent en traduisant et imitant des décisions et subjectivités humaines, contenues jusqu’au sein même des jeux de données qui sont fournis aux algorithmes pour l’apprentissage. Rien n’est neutre dans la VSA.

Au final, toutes ces stratégies ont une conséquence : dépolitiser la surveillance, en faire un objet banal et inéluctable, masquer sa véritable nature. On aimerait en rire mais que dire lorsque l’on voit que certaines entreprises comme Veesion ou l’ACN regrettent le caractère « anxiogène » de l’analyse de la CNIL quand elle évoque la versatilité des technologies ou le « changement de nature et de portée » des caméras ? Ou quand la SNCF exige de cette même CNIL qu’elle apporte preuves et études lorsqu’elle ne fait que relever « la dangerosité des technologies de [VSA] » et évoque le « sentiment de surveillance généralisée » ?

Ce déni de ce que représente la surveillance, de ce qu’elle a causé dans l’Histoire, des raisons pour lesquelles on a cherché à la limiter il y a cinquante ans, est vertigineux. La surveillance a été et sera toujours un instrument de pouvoir pour les États. Nier que la collecte, l’organisation et la rationalisation d’informations sur une population est source de contrôle pour qui les détiennent est une manœuvre non seulement cynique mais aussi dangereuse et révélatrice de la perte de repères politiques d’un grand nombre d’acteurs. Car on pourrait ne pas être surpris que ces pratiques éhontées viennent d’entreprises capitalistiques qui n’ont d’autre but que de faire du profit (et encore). Mais que dire lorsque l’on retrouve l’ensemble de ces stratégies et discours des industriels dans la bouche des ministres et des élus censés savoir que dans un État de droit qui se respecte, tout pouvoir étatique doit être contrôlé et limité ?

Nous nous battons depuis des années contre la surveillance abusive et le déploiement du contrôle de masse dans l’espace public. Aujourd’hui nous observons de façon inédite d’un côté la prégnance d’un marché tentaculaire de la sécurité, qui voit dans toute offre commerciale une occasion bonne à prendre, et de l’autre coté des gouvernants qui y répondent sans sourciller même si la demande n’existe pas et que les dangers sont réels. Ces manœuvres doivent être dénoncées. Car à mesure qu’elles s’installent comme des évidence, elles effacent de notre mémoire collective tous les exemples passés et présents de dérives du pouvoir étatique, de surveillance et de répression des populations. Elles participent à saper l’héritage des luttes démocratiques qui nous permettent de lutter contre les abus de pouvoirs et l’autoritarisme.

Luttons contre ce monde de la technopolice, luttons contre l’article 7 !

References

| ↑1 | Les autres réponses reçues et non citées dans l’article sont disponibles ici : celles de l’association 810, du lobby AFEP, de la ville de Cagnes-sur-mer, du Cerema (Centre d’études et d’expertise sur les risques, l’environnement, la mobilité et l’aménagement), du CNPEN (Comité national pilote d’éthique du numérique), de Décathlon, du Défenseur des droits, de l’entreprise délégué à la protection des données du ministère de l’Intérieur, de la Délégation à la protection des données (DPD) de la Ville et de l’Eurométropole de Strasbourg, du GPMSE (Groupement Professionnel des Métiers de la Sécurité Electronique), d’Île-de-France Mobilités, de la ville du Havre, de la ville de Neuilly -Plaisance, du PERIFEM (groupe réunissant les grandes enseignes de distribution, de l’entreprise Pizzorno, l’entreprise Quantaflow, du thinktank Renaissance Numérique, de l’entreprise Samsara, du groupe Transdev, de la Ville de Nice et de l’entreprise Wintics. |

|---|

Notre page de campagne contre la loi JO

Cette pétition s’adresse aux élu·es (conseillers municipaux, départementaux, régionaux, députés, sénateurs). Si possible, merci de nous indiquer votre signature depuis votre adresse mail officielle, afin de nous assurer qu’il s’agit bien de vous en écrivant à petition@technopolice.fr (merci de préciser votre mandat — par exemple « conseillère municipale de Paris (75) — et, le cas échéant, le parti auquel vous êtes rattaché·e). Nous refusons toute signature provenant de l’extrême-droite.

À travers l’article 7 du projet de loi relatif aux Jeux Olympiques 2024, le gouvernement entend légaliser la vidéosurveillance algorithmique (VSA). Il s’agit ainsi de satisfaire aux demandes des industriels et de certains responsables du ministère de l’Intérieur pour permettre, via une simple autorisation préfectorale, le couplage de l’Intelligence artificielle aux caméras de vidéosurveillance disposées dans les lieux publics ou placées sur des drones. Prenant pour prétexte les Jeux olympiques organisés à l’été 2024, l’article 7 autoriserait ces technologies de surveillance massive pour toutes les manifestations « sportives, culturelles ou récréatives », allant des matchs de Ligue 1 aux marchés de Noël en passant par les festivals de musique. Le tout au nom d’une prétendue expérimentation de deux ans devant s’achever en juin 2025, imposant à toutes les personnes qui assisteront à ces événements de devenir à la fois cobayes et victimes de ces algorithmes sécuritaires.

Qu’est-ce au juste que la VSA ? Il s’agit d’un type de logiciels consistant à automatiser l’analyse des flux de vidéosurveillance pour déclencher des alertes à destination des forces de police ou de sécurité dès lors que des « comportements suspects » sont repérés. Il peut par exemple s’agir du fait de rester statique dans l’espace public, de marcher à contre-sens de la foule, de se regrouper à plusieurs dans la rue ou encore d’avoir le visage couvert. Ces logiciels peuvent aussi suivre automatiquement le parcours d’une personne dans un territoire à l’aide d’attributs biométriques tels que la taille, le fait d’être perçu comme homme ou femme, ou encore la couleur de ses vêtements. Demain, il suffira de croiser ces technologies avec divers fichiers pour pratiquer massivement l’identification reconnaissance faciale — une fonctionnalité que proposent déjà de nombreuses startups et industriels positionnés sur ce marché, à l’image du logiciel Briefcam, dont les logiciels sont déployés dans plus de 200 communes françaises.

Si le gouvernement instrumentalise les Jeux olympiques en prétendant « expérimenter » la VSA, cela fait en réalité des années que des expérimentations ont lieu sur le territoire français, et ce en toute illégalité comme l’a lui-même reconnu le ministre de l’Intérieur. L’État a lui-même directement financé nombre de ces déploiements au travers du Fonds interministériel de prévention de la délinquance, de l’Agence nationale de la recherche ou du programme d’expérimentation lancé par le ministère de l’Intérieur pour Paris 2024 (lequel a par exemple conduit à tester la reconnaissance faciale lors du tournoi de Rolland Garros en 2021).

Quant aux prétendues garanties apportées par le gouvernement aux libertés publiques dans le cadre de ce projet de loi, elles apparaissent tout-à-fait dérisoires au regard des enjeux soulevés par la VSA. Contrairement à ce que prétendent ses promoteurs, ces technologies ne sont pas de simples outils d’« aide à la décision » : l’adoption de l’article 7 du projet de loi Jeux olympiques s’assimilerait à un véritable changement d’échelle et de nature dans la surveillance de la population, installant dans nos sociétés démocratiques des formes de contrôle social qui sont aujourd’hui l’apanage de pays autoritaires comme la Chine. C’est ce qu’explique la CNIL lorsqu’elle écrit que l’article 7 « ne constitue pas une simple évolution technologique de dispositifs vidéo, mais une modification de leur nature », ajoutant qu’un tel déploiement, « même expérimental, (…) constitue un tournant » . La Défenseure des droits met également en garde1 Réponse de la Défenseure des droits à la consultation de la CNIL<script type="text/javascript"> jQuery('#footnote_plugin_tooltip_20097_2_1').tooltip({ tip: '#footnote_plugin_tooltip_text_20097_2_1', tipClass: 'footnote_tooltip', effect: 'fade', predelay: 0, fadeInSpeed: 200, delay: 400, fadeOutSpeed: 200, position: 'top right', relative: true, offset: [10, 10], }); contre la VSA : selon elle, « le changement de paradigme » induit par le passage des « caméras de vidéoprotection « classiques » vers des dispositifs aux capacités de détection et d’analyse algorithmiques poussées est extrêmement préoccupant ». Elle insiste sur « les risques considérables que représentent les technologies biométriques d’évaluation pour le respect [des] droits »

Il est aussi particulièrement choquant de constater que, de l’aveu même de ses promoteurs, ce basculement vers la surveillance biométrique de l’espace public est motivé par des considérations économiques. Sous couvert d’expérimentation, la loi prépare la banalisation de ces technologies tout en permettant aux acteurs privés de peaufiner leur algorithmes avant leur généralisation. Lorsqu’on sait que l’achat d’une seule caméra coûte à une collectivité entre 25 et 40 000€ (sans la maintenance ni les logiciels d’analyse), on comprend aisément que la vidéosurveillance et son pendant algorithmique constituent une immense manne financière pour les industriels du secteur : 1,6 milliards d’euros de chiffre d’affaire sur l’année 20202Pixel 2022, page 96 consultable ici : data technopolice<script type="text/javascript"> jQuery('#footnote_plugin_tooltip_20097_2_2').tooltip({ tip: '#footnote_plugin_tooltip_text_20097_2_2', tipClass: 'footnote_tooltip', effect: 'fade', predelay: 0, fadeInSpeed: 200, delay: 400, fadeOutSpeed: 200, position: 'top right', relative: true, offset: [10, 10], }); rien qu’en France. Au niveau international, le marché devrait plus que doubler d’ici 2030 pour atteindre près de 110 milliards de dollars. Faisant fi du risque d’erreurs et d’abus en tous genres, certains promoteurs de la VSA expliquent dores et déjà qu’après la détection de « comportements suspects », les pouvoirs publics pourront amortir ces technologies en automatisant la vidéoverbalisation. Il y a donc fort à parier qu’une fois ces technologies achetées au prix fort, une fois des dizaines de milliers d’agent·es formé·es à leur utilisation, il sera pratiquement impossible de faire marche arrière.

Conscient·es du risque que fait peser la vidéosurveillance algorithmique sur la vie démocratique de nos sociétés, nombre d’élu·es de par le monde ont décidé d’interdire son usage. En décembre 2022, suite à l’adoption d’une résolution du Conseil municipal, la ville de Montpellier est devenue la première commune française à interdire la VSA. Elle a ainsi rejoint la liste des municipalités en Europe et aux États-Unis qui ont proscrit une telle surveillance biométrique sur leur territoire. En réponse à une pétition signée par des dizaines de milliers de citoyens à travers le continent, le Parlement européen discute lui aussi d’une interdiction de ces technologies.

Nous, élu·es de la République, refusons à notre tour le recours à la vidéosurveillance automatisée et le projet de société de surveillance qu’elle incarne. C’est pourquoi nous appelons chaque parlementaire à voter en conscience contre l’article 7 de la loi relative aux Jeux olympiques.

References

| ↑1 | Réponse de la Défenseure des droits à la consultation de la CNIL |

|---|---|

| ↑2 | Pixel 2022, page 96 consultable ici : data technopolice |

Aujourd’hui, La Quadrature lance une campagne contre l’article 7 de la loi JO 2024 et la vidéosurveillance algorithmique (VSA) ! Déjà voté par le Sénat, ce texte utilise les Jeux olympiques comme prétexte pour légaliser la VSA et faire accepter la surveillance biométrique en France. Il arrive à l’Assemblée nationale dans quelques semaines et nous allons avoir besoin de vous pour le combattre et faire rejeter cet article !

Voulu de longue date par le gouvernement, et fortement poussé par la police et le marché grandissant de la sécurité privée, le texte vise à donner une base légale à une technologie déjà présente dans les villes de France. Il ne s’agit pas d’une simple évolution technique mais d’un véritable changement de paradigme : à travers des algorithmes couplés aux caméras de surveillance, ces logiciels détectent, analysent et classent nos corps et comportements dans l’espace public. Le projet derrière ? Traquer les comportements soi-disant « suspects » et éradiquer de la rue des actions anodines mais perçues par l’État comme nuisibles ou anormales. En effet, ces algorithmes peuvent par exemple repérer le fait de rester statique dans l’espace public, de marcher à contre-sens de la foule, de se regrouper à plusieurs dans la rue ou encore d’avoir le visage couvert.

Ces outils de surveillance biométrique sont intrinsèquement dangereux et ne peuvent être contenus par aucun garde-fou, qu’il soit légal ou technique. Les accepter c’est faire sauter les derniers remparts qui nous préservent d’une société de surveillance totale. Seuls le rejet et l’interdiction de la VSA doivent être envisagés. C’est pour cela que nous lançons une campagne de mobilisation dès aujourd’hui afin de lutter ensemble contre la surveillance biométrique.

Retrouvez ici la page de campagne. Nous vous y proposons plusieurs moyens d’actions pour les prochaines semaines :

Luttons ensemble pour repousser l’article 7 et la surveillance totale !

<style>.technobouton{display:block;background-color:#ff4200;padding:1em;color:black;margin:auto;text-align:center;margin:3em;border:5px solid black;font-weight:bold;}.technobouton:visited{color:black;}.technobouton:hover{border:5px solid #ff4200;color:#ff4200;background-color:black;}Loi J.O. : Refusons la surveillance biométrique !

Courant mars, l’Assemblée nationale va se prononcer sur le projet de loi relatif aux Jeux olympiques et paralympiques, déjà adopté par le Sénat. En son sein, l’article 7 vise à autoriser la vidéosurveillance automatisée (VSA), cet outil de surveillance biométrique qui, à travers des algorithmes couplés aux caméras de surveillance, détecte, analyse et classe nos corps et comportements dans l’espace public. Il s’agit d’un changement d’échelle sans précédent dans les capacités de surveillance et de répression de l’État et de sa police.

Sur cette page, vous retrouverez un ensemble de ressources et d’outils pour vous permettre de vous engager contre la VSA et contre l’article 7 du projet de loi Jeux olympiques.

Une frise chronologique des passages à l’Assemblée indiquant les meilleurs jours pour téléphoner aux député·es

Un « Piphone » : un outil qui fournit les numéros des député·es

Un argumentaire pour convaincre les député·es

1 · Frise législative : quel est le meilleur moment pour appeler ?

2 · Piphone : choisir quel·le député·e appeler

Stratégiquement, nous vous conseillons d’appeler les député·es de la majorité (Renaissance, Horizons et Modem) et du PS (qui s’est abstenu au Sénat). Vous pouvez les contacter toute la semaine et si possible les lundi, jeudi et vendredi, lorsqu’ils ne sont pas dans l’hémicycle. C’est probable que vous ayez un·e assistant·e au téléphone et ce n’est pas grave ! N’hésitez surtout pas à lui parler, en lui demandant ensuite de relayer votre opinion auprès de son ou de sa députée.

3 · Argumentaire : convaincre le·a député·e de rejeter l’article 7

Appelons sans relâche les député·es afin de faire pression sur la majorité présidentielle et les élu·es qui pourraient changer le cours du vote.

Pour les convaincre, nous avons préparé quelques arguments phares que vous pouvez sélectionner, utiliser, remanier à votre sauce lorsque vous appelez les parlementaires. D’abord, cinq points d’alarme sur les dangers de la vidéosurveillance algorithmique. Ensuite deux « débunkages » d’arguments que l’on retrouve souvent dans la bouche des adeptes de la surveillance.

La VSA est par essence un outil de surveillance totale :

La VSA n’est pas un simple logiciel : elle analyse des milliers d’heures de vidéos pour catégoriser les comportements suivant ce que les autorités auront qualifié de « suspect » ou « anormal » pour l’appliquer en temps réel sur les caméras de surveillance. Cela crée un gigantesque système de ciblage « d’anomalies » afin d’automatiser le travail de la police. Il s’agit d’un réel changement de dimension de la surveillance et d’industrialisation du travail d’image pour démultiplier les notifications et interpellations, guidées par cette intelligence artificielle.

La VSA existe déjà et est déployée dans l’opacité

Déployée ces dernières années en toute opacité, la VSA est une technologie quasiment inconnue de la population. Développée et vendue discrètement par des entreprises, elle est implantée sans information par les collectivités, empêchant les habitant·es d’avoir facilement accès à ce qui est installé dans leur ville. Ce déploiement ne répond pas à un besoin démocratique mais à des logiques économiques alors qu’aucune preuve d’efficacité n’existe.

Par exemple, le logiciel de l’entreprise Briefcam, déployé en catimini dans plus de 200 municipalités en France, permet de réaliser des recherches par attributs (couleur des vêtements, couvre-chef, sac, type de vêtement et supposé genre de la personne), de faire du suivi de personne à travers toutes les caméras de la ville et possède même l’option « comparaison faciale » qui permet de faire une recherche parmi les flux vidéos du visage identifié. C’est grâce à un long travail de documentation de notre part et d’investigation de journalistes qu’il a été possible de comprendre ce que peut réellement faire ce fameux logiciel de VSA le plus vendu en France.

Cette opacité rend totalement impossible l’expression d’un choix démocratique sur la question.

La VSA n’est pas moins dangereuse que la reconnaissance faciale.

La VSA et la reconnaissance faciale reposent sur les mêmes algorithmes d’analyse d’images et de surveillance biométrique. La seule différence est que la première isole et reconnaît des corps, des mouvements ou des objets, lorsque la seconde détecte un visage. Ce sont généralement les mêmes entreprises qui développent ces deux technologies. Par exemple, la start-up française Two-I s’est d’abord lancé dans la détection d’émotion, a voulu la tester dans les tramways niçois, avant d’expérimenter la reconnaissance faciale sur des supporters de football à Metz. Finalement, l’entreprise semble se concentrer sur la VSA et en vendre à plusieurs communes de France. La VSA est une technologie biométrique intrinsèquement dangereuse, l’accepter c’est ouvrir la voie aux pires outils de surveillance.

La France est la cheffe de file de l’Europe en terme de surveillance

Avec cette loi, la France sera le premier État membre de l’Union européenne à légaliser et autoriser la surveillance biométrique, à l’opposée d’autres positionnements au sein de l’UE. Les discussions actuellement en cours sur le règlement européen sur l’intelligence artificielle envisagent même son interdiction formelle. La France confirmerait sa place de cheffe de file de la surveillance en Europe, s’éloignant toujours plus des idéaux de respect des droits fondamentaux et se rapprochant de la culture de la surveillance d’autres pays plus autoritaires. Les pays qui ont profité d’évènements sportifs pour tester et rendre acceptables des technologies de surveillance sont la Russie, la Chine et le Qatar.

Aucun garde-fous possible pour la VSA

Pour faire des traitements d’images pointus et reconnaître des formes avec précision, les algorithmes de VSA doivent être basés sur une technologie complexe dite de « deep learning » qui fonctionne grâce à des calculs si sophistiqués qu’ils dépassent l’entendement humain. L’algorithme décide lui-même quels paramètres sont pertinents pour détecter un évènement, sans qu’il soit possible de savoir lesquels ont été retenus pour donner le résultat. Il est impossible de garantir que le logiciel n’exploitera pas de données sensibles et de caractéristiques biométriques. Même les concepteurs de ces algorithmes n’ont pas de visibilité sur les données qu’ils exploitent. Ces technologies sont intrinsèquement dangereuses et ne pourront jamais être limitées efficacement sur le plan légal ou technique. Le seul garde-fou envisageable est l’interdiction de leur usage sur des activités humaines filmées dans l’espace public.

Réponses aux contre-arguments

« La VSA sera expérimentée uniquement pour les Jeux Olympiques »

FAUX, les Jeux Olympiques ne sont pas une expérimentation : la VSA est déjà déployée en toute opacité et illégalité et continuera à l’être après. On a retrouvé des traces de contrat entre la ville de Toulouse et IBM pour détecter des comportements anormaux dès 2017, on compte au bas mot deux cent villes en France qui l’emploient et elle s’installe aussi dans les magasins. Il y a donc un projet politique de long terme et les JO ne sont donc qu’un prétexte pour tenter de légaliser cette technologie. Après les Jeux, la vidéosurveillance algorithmique sera généralisée : une fois que des dizaines de milliers d’agents de sécurité et de police sont formés, que la technologie est achetée et mise au point grâce à des fonds publics, il faudra bien la rentabiliser. Son abandon après cette soi-disant expérimentation est donc illusoire.

« La VSA est seulement une aide à la décision »

Faux, la VSA n’est pas une simple aide technique : pour la concevoir, les entreprises doivent prendre une série de décisions morales et subjectives (qu’est-ce qu’un comportement « suspect » ?). Son application est également politique puisque la VSA est un instrument de pouvoir donné à des services coercitifs. La VSA n’est pas un outil neutre mais analyse en permanence les corps et les déplacements, en particulier de celles et ceux qui passent le plus de temps dans la rue. Se cacher derrière une machine, c’est déresponsabiliser les choix des agents de sécurité : « c’est pas nous qui avons ciblé cette personne, c’est l’algorithme ». C’est aussi accepter la déshumanisation du rapport des citoyens avec l’État, qui finira par ne prendre que des décisions automatisées sur sa population comme cela commence à être le cas avec la vidéoverbalisation. La VSA n’est pas une « aide à la décision » mais constitue bien un changement d’échelle dans les capacités de surveillance de l’État.